MLPs and CNNs work with bounded data

MLPs and (partially) CNNs are not designed for sequential data instead they are usually designed for fixed sized data: an image is bounded whereas sequential data have variable lengths

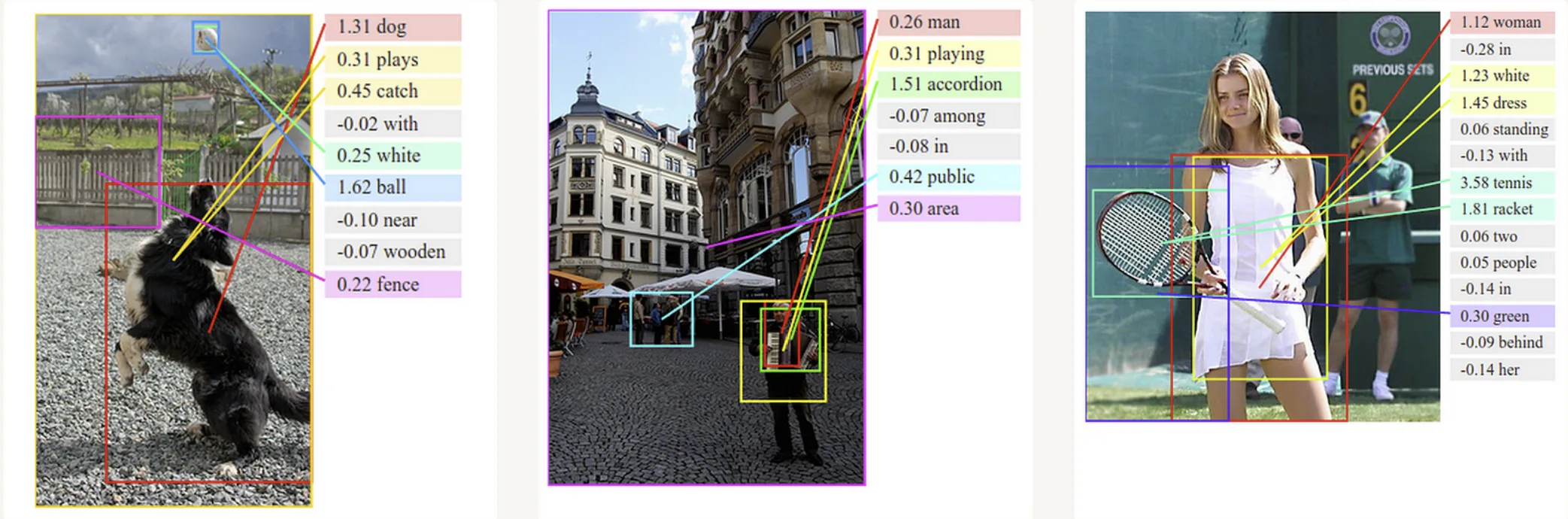

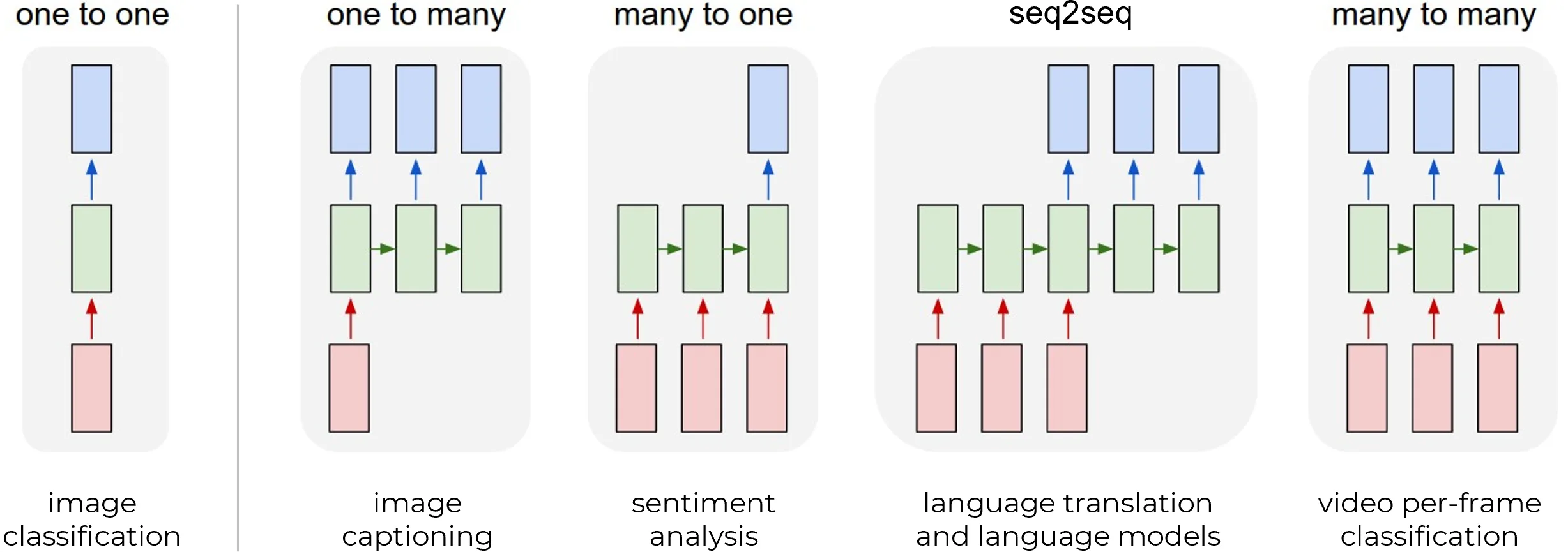

Taxonomy of sequential problems

In general the following macro-categories of sequential problems can be defined.

| Categoria | Descrizione | Esempi |

|---|---|---|

| One-to-Many | Da un singolo input si genera una sequenza di output. | Rilevamento di oggetti (Object Detection): Si possono rilevare molteplici regioni e quindi oggetti da una singola immagine. |

| Many-to-One | Da una sequenza di input si ottiene un singolo output. | Sentiment Analysis: Una sequenza di parole (un post) viene classificata con un singolo valore (e.g. positivo, negativo). |

| Seq2Seq | Sia l’input che l’output sono sequenze di lunghezza non predefinita. È il paradigma più generale (proprio in virtu dei pochi vincoli su input e ouput), in cui eccellono architetture come RNN e Transformer. | Chatbot: Una sequenza di parole (domanda) genera un’altra sequenza di parole (risposta). Previsione di Traiettorie: Una sequenza di punti che codifica la traiettoria precedente viene usata per prevedere una sequenza di punti che codifica la successiva porzione della traiettoria. |

| Many-to-Many | Da una sequenza di input si genera una sequenza di output, dove ogni output corrisponde a un elemento dell’input. | Classificazione di frame video (Video Per-Frame Classification): Una sequenza di frame di un video (input) viene analizzata per classificare ogni singolo frame (output). |

- seq2seq: the applications which fall under this category are the ones for which RNNs and Transformers shine. seq2seq is the most general paradigm and this generality lies in the fact that both the input and the output are a sequence of things not bounded.

Examples:

- In a chatting session with a chat bot the input, the text i give to the chatbot, and the output, that is the chatbot answer, are both variable length answer).

- Also trajectory prediction falls in this category: in this case the input is a sequence which is the previous trajectory points and the goal is to predict the next chunk of trajectory and then going on and on with time.

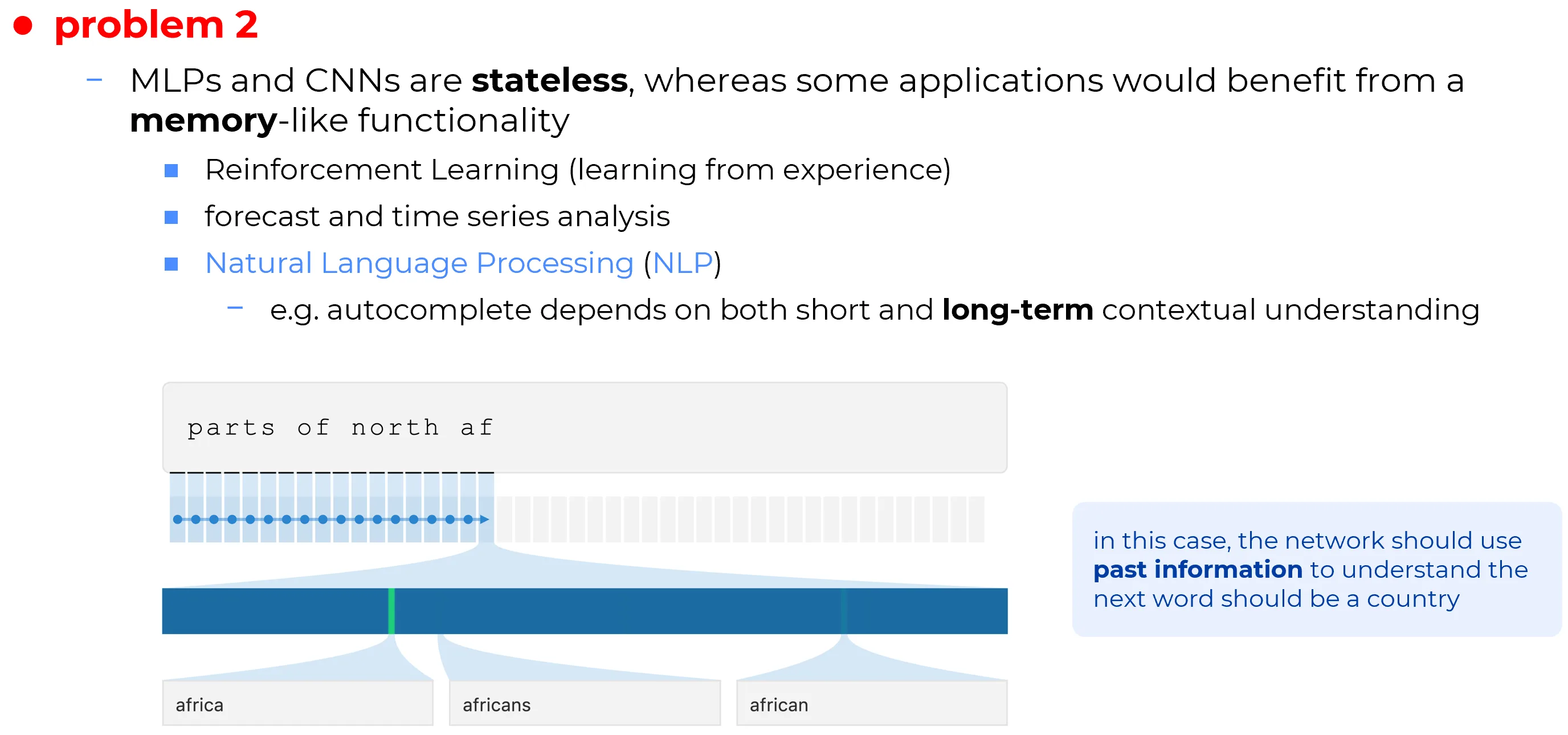

MLPs and CNNs are stateless

These architectures doesn’t store any data.

the network must have knowledge retention